Wyobraź sobie przez chwilę, że kluczowy element twojego sukcesu nagle zostaje ujawniony całemu światu. To właśnie sytuacja, w której znalazła się Anthropic, firma niegdyś dyskretna, dziś w pełnym świetle z powodu wycieku kodu. Jak takie wydarzenie mogłoby wpłynąć na przyszłość sztucznej inteligencji i technologii z niej wynikających? Odkryj, jak to zamieszanie mogłoby zdefiniować na nowo obecny krajobraz technologiczny.

3 informacje, których nie można przegapić

- Aplikacja Claude firmy Anthropic zdołała przewyższyć ChatGPT i Gemini w App Store, głównie dzięki swojej zdolności do zarządzania złożonymi zadaniami.

- Błąd ludzki umożliwił wyciek kodu źródłowego Claude Code, ujawniając kluczowe informacje na temat zarządzania projektami przez to narzędzie.

- Chociaż ten wyciek nie zawiera samych modeli sztucznej inteligencji, ujawnia mechanizmy bezpieczeństwa, zwiększając ryzyko ataków hakerskich.

Anthropic i wzrost Claude

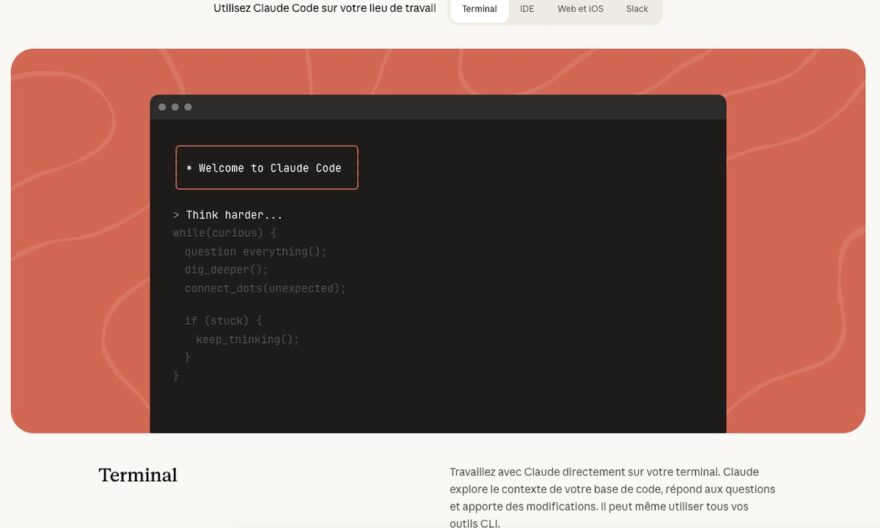

Anthropic, długo pozostająca w cieniu innych gigantów AI, niedawno dokonała znaczącego przełomu dzięki swojej aplikacji Claude. Specjalnie zaprojektowana do obsługi złożonych zadań, Claude szybko zyskała popularność, przewyższając narzędzia takie jak ChatGPT i Gemini. Ten wzrost mocy można w dużej mierze przypisać wydaniu wersji Opus 4.6, która oznaczała punkt zwrotny w efektywności aplikacji.

Wpływ wycieku Claude Code

Niespodziewane ujawnienie kodu źródłowego Claude Code wynika z prostego błędu ludzkiego podczas aktualizacji rejestru npm. Plik przeznaczony do wewnętrznego debugowania został przypadkowo upubliczniony, dając możliwość odtworzenia całego kodu. Ten wyciek, choć nie zawiera mózgu AI, ujawnia jednak wiele tajemnic dotyczących jego działania.

Konsekwencje dla bezpieczeństwa i konkurencji

Wyciek kodu Claude Code nie pozostaje bez konsekwencji. Ujawnia on w szczególności mechanizmy bezpieczeństwa narzędzia, otwierając drogę do prób ataków hakerskich mających na celu wykorzystanie tych luk. Dla Anthropic, której znaczna część przychodów zależy od tego narzędzia, sytuacja stanowi poważne wyzwanie. Równocześnie, jej konkurenci mogą wykorzystać te informacje do ulepszenia własnych rozwiązań.

Przyszłość modeli open source inspirowanych Claude

Z kodem obecnie dostępnym, deweloperzy na platformach takich jak Reddit już zaczęli się nim inspirować, tworząc wersje open source. Choć to zjawisko może zwiększyć dostępność zaawansowanych technologii, rodzi również pytania o trwałość przewagi Anthropic. Prawdziwym testem dla firmy będzie pozostanie na czele innowacji pomimo tego ujawnienia.

Wyzwania bezpieczeństwa w AI

Wyciek Claude Code uwydatnia powtarzający się problem w dziedzinie sztucznej inteligencji: bezpieczeństwo kodów źródłowych. Firmy muszą podwoić wysiłki, aby chronić swoje innowacje przed przypadkowymi wyciekami i złośliwymi atakami. W przyszłości bezpieczeństwo danych i algorytmów stanie się kluczowym zagadnieniem dla zapewnienia trwałości i zaufania do technologii AI.